La présence croissante du génératif IA dans les opérations gouvernementales

Les gouvernements des États et locaux des États-Unis explorent activement les moyens de mettre en œuvre l’intelligence artificielle générative, telle que ChatGPT, pour améliorer l’efficacité administrative et les services publics. Cependant, cette adoption rapide a déclenché des débats sur les implications éthiques, la sécurité des données et la transparence publique. Les incohérences dans l’approche réglementaire à l’égard de ces technologies avancées sont évidentes. Par exemple, l’Agence américaine de protection de l’environnement a interdit l’accès de ses employés à ChatGPT, tandis que le personnel du Département d’État américain en Guinée l’utilise pour diverses tâches telles que la rédaction de discours.

Le sac mélangé : différentes approches selon les États

Différents États affichent des attitudes contrastées à l’égard de l’IA générative. Le Maine, par exemple, a imposé une interdiction temporaire de l’utilisation de l’IA générative par son pouvoir exécutif, invoquant des problèmes de cybersécurité. À l'opposé, le Vermont encourage ses employés du gouvernement à utiliser la technologie à des fins éducatives, comme l'apprentissage de nouveaux langages de programmation, comme l'a révélé Josiah Raiche, directeur de l'intelligence artificielle de l'État.

Gouvernements locaux et IA générative : un examen plus approfondi

Les municipalités formulent également des lignes directrices pour réglementer l’utilisation de l’IA générative. San Jose, en Californie, a rédigé un document d'orientation complet de 23 pages et exige que les employés municipaux remplissent des formulaires chaque fois qu'ils utilisent des outils d'IA comme ChatGPT. Le comté d'Alameda, non loin de San José, opte pour une approche plus flexible. Bien qu’ils aient organisé des sessions éducatives sur les risques associés à l’IA, ils n’ont pas encore établi de politique formelle. Sybil Gurney, directrice adjointe de l'information du comté, a fait remarquer que l'accent est mis sur « ce que vous pouvez faire, et non sur ce que vous ne pouvez pas faire ».

Optimisme tempéré par la responsabilité

Les responsables gouvernementaux reconnaissent le potentiel de l’IA générative pour atténuer les inefficacités bureaucratiques. Cependant, ils soulignent également les défis uniques posés par le besoin de transparence du secteur public, le respect de lois strictes et le sens primordial de la responsabilité civique. Jim Loter, directeur technologique par intérim de Seattle, souligne le niveau élevé de responsabilité requis lors de la mise en œuvre de l'IA dans les processus gouvernementaux. Il estime que la divulgation publique et les pratiques équitables doivent être une priorité, surtout compte tenu des enjeux élevés impliqués dans la prise de décision gouvernementale.

Scénarios mettant en évidence les enjeux : un cas dans l’Iowa

Les événements récents ont montré à quel point ces enjeux peuvent être importants. Le mois dernier, un surintendant adjoint de Mason City, Iowa, a utilisé ChatGPT pour l'aider à décider quels livres devraient être retirés des bibliothèques scolaires. Cet incident, mandaté par la loi de l’État, a attiré l’attention et un examen minutieux à l’échelle nationale, soulevant des questions sur la responsabilité des décisions d’IA au sein du gouvernement.

Lois sur les archives publiques et sécurité des données

Il existe un autre niveau de complexité : les archives publiques et la sécurité des données. San Jose, Seattle et l'État de Washington ont alerté le personnel sur le fait que toutes les données utilisées dans les modèles d'IA générative sont soumises aux lois sur les archives publiques. Ces informations sont également utilisées pour entraîner ces modèles d’IA, augmentant ainsi le risque de fuite ou de mauvaise gestion d’informations sensibles. De plus, une étude de l’Institut de Stanford pour l’intelligence artificielle centrée sur l’humain souligne que plus ces modèles d’IA deviennent précis, plus ils sont susceptibles de réutiliser de gros blocs de contenu de leurs ensembles de formation.

Défis en matière de soins de santé et de justice pénale

Les agences de santé et de justice pénale sont confrontées à une série de problèmes supplémentaires. Prenons l’exemple d’une situation hypothétique dans laquelle des employés de Seattle utilisent l’IA pour résumer les rapports d’enquête de leur Bureau de responsabilité de la police. Ces rapports peuvent contenir des informations sensibles mais qui relèvent néanmoins des archives publiques, ce qui ajoute une couche de complexité à leur utilisation responsable.

Implications juridiques et confiance du public

En Arizona, les employés de la Cour supérieure du comté de Maricopa utilisent l'IA générative à des fins internes, mais Aaron Judy, responsable de l'innovation et de l'IA du tribunal, admet qu'il y aurait des réserves quant à son utilisation pour les communications publiques. La préoccupation sous-jacente est le dilemme éthique lié à l’utilisation de la contribution des citoyens pour former un modèle d’IA axé sur le profit.

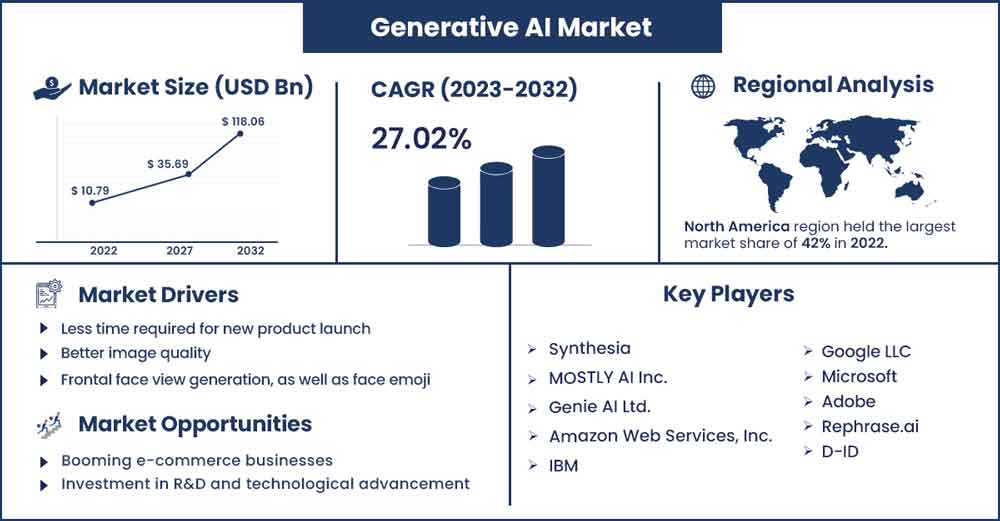

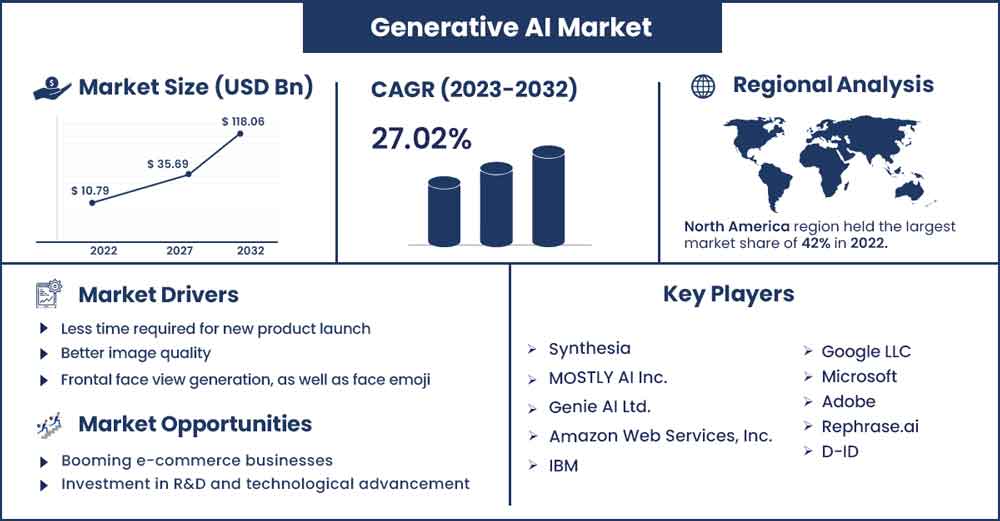

L'IA générative dans la technologie civique et les politiques futures

De grandes entreprises technologiques et cabinets de conseil, tels que Microsoft, Google, Deloitte et Accenture, promeuvent activement les solutions d'IA générative au niveau fédéral. Les villes et les États devraient affiner et améliorer leurs politiques dans les mois à venir. Albert Gehami, responsable de la protection de la vie privée à San Jose, prédit que ces règles connaîtront une évolution substantielle à mesure que la technologie mûrira.

La nécessité d’une surveillance fédérale

Alors que les gouvernements locaux et étatiques ont fait de premiers progrès dans la formulation de politiques en matière d’IA, il existe un besoin urgent de lignes directrices fédérales. Alexandra Reeve Givens, présidente et directrice générale du Centre pour la démocratie et la technologie, estime que la situation exige un « leadership clair » de la part du gouvernement fédéral pour établir des protocoles détaillés et standardisés.

Conclusion : l’exercice d’équilibre

À mesure que les technologies d’IA générative sont de plus en plus intégrées aux opérations gouvernementales, le défi sera de trouver un équilibre entre l’exploitation de leurs capacités au profit du public et la garantie de la sécurité des données, des normes éthiques et de la transparence. Alors que les gouvernements continuent d’expérimenter et d’apprendre, un examen attentif et une mise en œuvre responsable seront les clés pour exploiter tout le potentiel de cette technologie transformatrice.