A crescente presença do generativo IA em Operações Governamentais

Os governos estaduais e locais nos Estados Unidos estão explorando ativamente formas de implementar inteligência artificial generativa, como o ChatGPT, para melhorar a eficiência administrativa e os serviços públicos. No entanto, esta rápida adoção acendeu debates sobre implicações éticas, segurança de dados e transparência pública. As inconsistências na abordagem regulamentar em relação a estas tecnologias avançadas são evidentes. Por exemplo, a Agência de Protecção Ambiental dos EUA proibiu o acesso dos funcionários ao ChatGPT, enquanto o pessoal do Departamento de Estado dos EUA na Guiné o utiliza para diversas tarefas, como redigir discursos.

O saco misto: diferentes abordagens entre os estados

Vários estados apresentam atitudes contrastantes em relação à IA generativa. Maine, por exemplo, impôs uma proibição temporária da utilização de IA generativa pelo seu poder executivo, citando preocupações de segurança cibernética. Em total contraste, Vermont está a encorajar os seus funcionários governamentais a utilizar a tecnologia para fins educacionais, como aprender novas linguagens de programação, conforme revelado por Josiah Raiche, o diretor de inteligência artificial do estado.

Governos locais e IA generativa: um olhar mais atento

Os municípios também estão a formular diretrizes para regular a utilização de IA generativa. San Jose, Califórnia, elaborou um documento de orientação abrangente de 23 páginas e exige que os funcionários municipais preencham formulários sempre que utilizarem ferramentas de IA como o ChatGPT. O condado de Alameda, não muito longe de San Jose, opta por uma abordagem mais flexível. Embora tenham organizado sessões educativas sobre os riscos associados à IA, ainda não estabeleceram uma política formal. Sybil Gurney, diretora assistente de informação do condado, observou que o foco deles está “no que você pode fazer, não no que não pode fazer”.

Otimismo temperado pela responsabilidade

Os funcionários do governo reconhecem o potencial da IA generativa para aliviar as ineficiências burocráticas. No entanto, sublinham também os desafios únicos colocados pela necessidade de transparência do sector público, pela adesão a leis rigorosas e pelo sentido abrangente de responsabilidade cívica. Jim Loter, diretor interino de tecnologia de Seattle, enfatiza o elevado nível de responsabilidade necessário ao implementar IA em processos governamentais. Ele acredita que a divulgação pública e as práticas equitativas devem ser uma prioridade, especialmente tendo em conta os elevados riscos envolvidos na tomada de decisões governamentais.

Cenários que destacam o que está em jogo: um caso em Iowa

Acontecimentos recentes mostraram quão elevados podem ser esses riscos. No mês passado, um superintendente assistente em Mason City, Iowa, usou o ChatGPT para ajudar a decidir quais livros deveriam ser removidos das bibliotecas escolares. Este incidente, exigido por lei estatal, atraiu a atenção e o escrutínio nacional, levantando questões sobre a responsabilização das decisões de IA no governo.

Leis de registros públicos e segurança de dados

Existe ainda uma camada adicional de complexidade: registos públicos e segurança de dados. Os estados de San Jose, Seattle e Washington alertaram a equipe de que quaisquer dados usados em modelos generativos de IA estão sujeitos a leis de registros públicos. Essas informações também são usadas para treinar esses modelos de IA, aumentando o risco de vazamento ou manuseio indevido de informações confidenciais. Além disso, um estudo do Stanford Institute for Human-Centered Artificial Intelligence aponta que quanto mais precisos estes modelos de IA se tornam, maior é a probabilidade de reutilizarem grandes blocos de conteúdo dos seus conjuntos de treino.

Desafios na saúde e na justiça criminal

As agências de saúde e de justiça criminal enfrentam um conjunto adicional de problemas. Considere a situação hipotética em que os funcionários de Seattle usam IA para resumir relatórios investigativos do seu Escritório de Responsabilidade Policial. Esses relatórios podem conter informações confidenciais, mas ainda assim incluídas em registros públicos, acrescentando uma camada de complexidade ao seu uso responsável.

Implicações legais e confiança pública

No Arizona, os funcionários do Tribunal Superior do Condado de Maricopa utilizam IA generativa para fins internos, mas Aaron Judy, chefe de inovação e IA do tribunal, admite que haveria reservas quanto à sua utilização para comunicações públicas. A preocupação subjacente é o dilema ético de usar a contribuição dos cidadãos para treinar um modelo de IA orientado para o lucro.

IA generativa em tecnologia cívica e políticas futuras

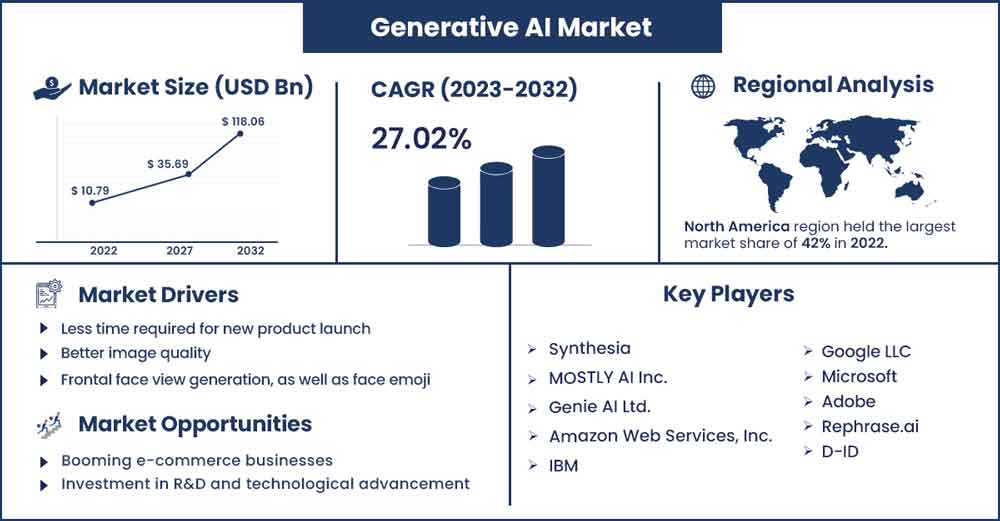

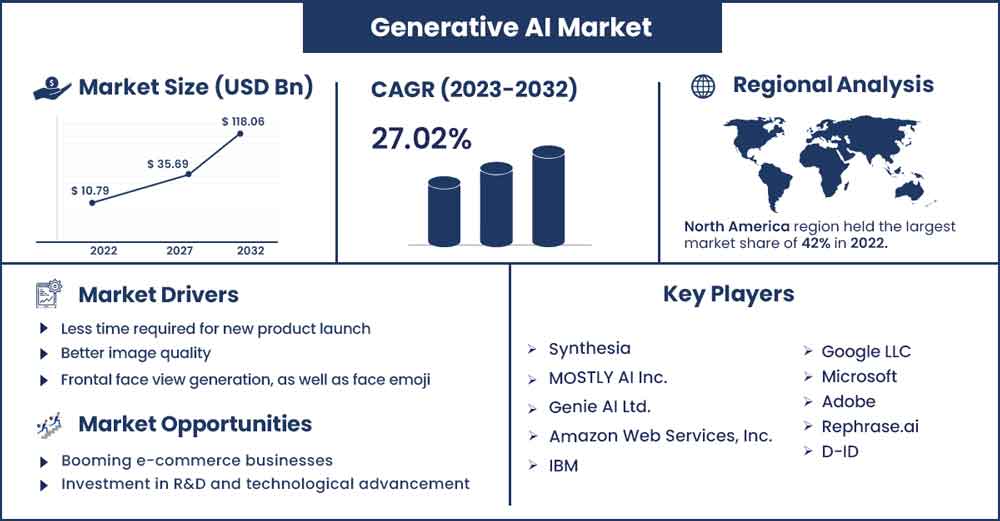

As principais empresas e consultorias tecnológicas, como a Microsoft, a Google, a Deloitte e a Accenture, estão a promover ativamente soluções generativas de IA a nível federal. Espera-se que as cidades e os estados refinem e melhorem as suas políticas nos próximos meses. Albert Gehami, responsável pela privacidade de San Jose, prevê que estas regras sofrerão uma evolução substancial à medida que a tecnologia amadurece.

A necessidade de supervisão federal

Embora os governos locais e estaduais tenham feito avanços iniciais na formulação de políticas de IA, há uma necessidade premente de diretrizes federais. Alexandra Reeve Givens, presidente e CEO do Centro para Democracia e Tecnologia, acredita que a situação exige “liderança clara” do governo federal para estabelecer protocolos detalhados e padronizados.

Conclusão: A Lei de Equilíbrio

À medida que as tecnologias generativas de IA se tornam cada vez mais integradas nas operações governamentais, o desafio será encontrar um equilíbrio entre aproveitar as suas capacidades para benefício público e garantir a segurança dos dados, os padrões éticos e a transparência. À medida que os governos continuam a experimentar e a aprender, um escrutínio atento e uma implementação responsável serão as chaves para aproveitar todo o potencial desta tecnologia transformadora.